Agentic AI란? — 스스로 판단하고 행동하는 AI의 시대

2026년 AI의 핵심 키워드 Agentic AI. 기존 챗봇과 뭐가 다른지, 어디에 쓰이는지, 대표 프레임워크까지 한번에 정리.

ChatGPT가 나왔을 때만 해도 "AI한테 물어보면 답해준다" 정도가 대중의 인식이었다. 근데 2025년쯤부터 분위기가 달라졌다. AI가 단순히 질문에 답하는 게 아니라, 스스로 계획을 세우고, 도구를 쓰고, 결과를 보고 다음 행동을 결정하는 방향으로 진화하기 시작한 거다.

이걸 업계에서는 Agentic AI라고 부른다.

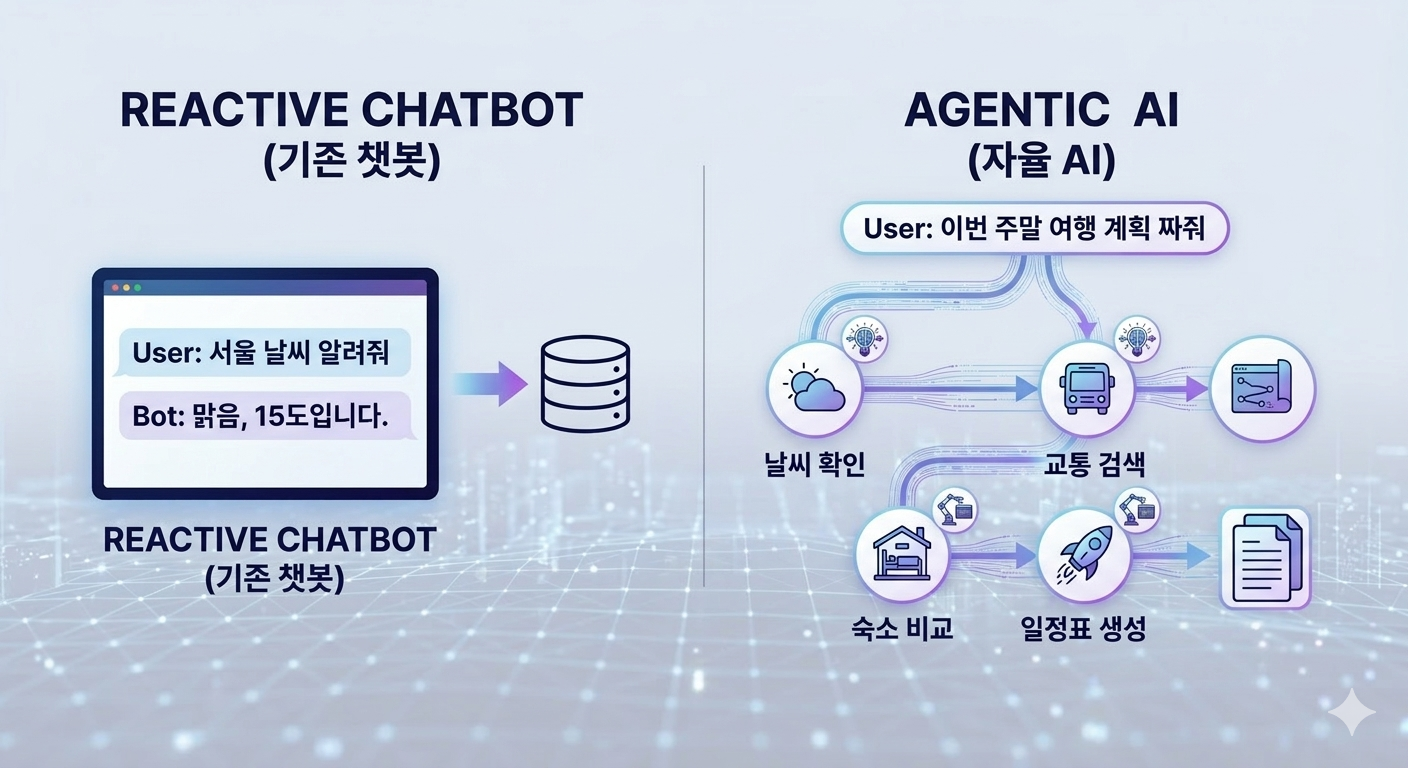

챗봇이랑 뭐가 다른데

기존 AI 챗봇은 한마디로 **리액티브(reactive)**하다. 사용자가 질문하면 답하고, 그걸로 끝. 이전 대화를 기억하긴 하지만 스스로 뭔가를 하진 않는다.

Agentic AI는 다르다. 목표를 주면 그걸 달성하기 위한 단계를 자기가 쪼개고, 각 단계를 실행하면서 중간 결과에 따라 경로를 수정한다. 실패하면 다른 방법을 시도하고, 필요한 정보가 없으면 검색 도구를 직접 호출해서 찾아온다.

비유하자면:

- 챗봇: "서울 날씨 알려줘" → "맑음, 15도입니다"

- 에이전트: "이번 주말 여행 계획 짜줘" → 날씨 확인 → 교통 검색 → 숙소 비교 → 일정표 생성

한 번의 질문-응답으로 끝나는 게 아니라, 여러 단계를 돌면서 결과를 만들어낸다는 게 본질적인 차이다.

에이전트는 어떻게 굴러가는가

Agentic AI의 동작 원리를 네 단어로 요약하면 **"계획 → 도구 → 관찰 → 반복"**이다. 근데 이걸 네 개의 섹션으로 쪼개서 설명하면 오히려 감이 안 오니까, 하나의 시나리오로 풀어보겠다.

누군가가 코딩 에이전트한테 이런 지시를 내렸다고 하자.

"이 프로젝트에서 API 응답 시간이 느린 엔드포인트를 찾아서 최적화해줘."

에이전트는 먼저 계획을 세운다. 프로젝트 구조를 파악하고, API 라우트 파일들을 확인하고, 벤치마크를 돌려볼 순서를 정한다. 여기서 핵심은 사람이 단계를 지정한 게 아니라는 점이다. "어떻게 할지"를 AI가 스스로 결정한다.

다음으로 도구를 쓴다. 파일 시스템을 읽어서 코드를 분석하고, 터미널에서 프로파일링 도구를 실행하고, 데이터베이스 쿼리 실행 시간을 측정한다. LLM 자체는 텍스트만 다룰 줄 아는데, 이런 도구들을 연결해주면 현실 세계와 상호작용할 수 있게 된다. LLM은 "어떤 도구를 언제 쓸지" 판단하는 두뇌 역할을 하는 셈이다.

그리고 결과를 관찰한다. 프로파일링 결과를 보니 특정 엔드포인트에서 N+1 쿼리 문제가 발견됐다. 에이전트는 이 결과를 해석하고 수정 방향을 잡는다.

마지막으로 행동을 수정한다. 코드를 고치고, 테스트를 돌려보고, 통과하면 다음 엔드포인트로 넘어간다. 테스트가 깨지면? 에러 로그를 분석해서 다시 수정한다. 이 루프가 목표를 달성할 때까지 계속 돈다.

이 과정에서 메모리도 중요하다. "아까 3번 엔드포인트에서는 인덱스 추가로 해결했으니, 비슷한 패턴이 보이면 같은 접근을 쓰자"는 식의 판단을 하려면 이전 작업을 기억해야 하니까. 단기 메모리(현재 작업 맥락)와 장기 메모리(사용자 선호, 과거 이력)를 조합해서 더 똑똑한 결정을 내린다.

2026년, 이미 쓰이고 있는 곳들

가장 활발한 영역은 단연 코딩 에이전트다. Claude Code, GitHub Copilot Workspace, Cursor 같은 도구들이 대표적인데, 이들의 공통점은 코드 자동완성을 넘어섰다는 거다. 이슈를 분석하고, 코드를 수정하고, 테스트를 돌리고, PR을 생성하는 전체 워크플로우를 처리한다. 2024년까지는 "AI가 코드를 짜준다"였는데, 2026년에는 "AI가 개발 업무를 수행한다"에 가깝다.

고객 지원 쪽도 꽤 진전이 있다. 예전에는 챗봇이 FAQ에서 답을 찾아주는 수준이었는데, 이제는 주문 시스템을 조회하고, 환불을 처리하고, 필요하면 상위 상담원에게 에스컬레이션까지 판단한다. 단순 응대가 아니라 실제 업무 처리까지 하는 거다.

데이터 분석이나 업무 자동화도 빠르게 확산 중이다. "지난 분기 매출 이상치 찾아줘"라고 하면 데이터 로드 → 통계 분석 → 시각화 → 보고서까지 한 흐름으로 처리하고, n8n이나 Make 같은 자동화 플랫폼에 LLM을 연결해서 이메일 분류, 문서 요약, 일정 관리를 에이전트에 위임하는 사례도 늘고 있다.

프레임워크 — 뭘로 만드나

직접 에이전트를 만들어보고 싶다면 선택지가 꽤 있다. 근데 프레임워크마다 철학이 달라서, 자기 상황에 맞는 걸 고르는 게 중요하다.

| 프레임워크 | 만든 곳 | 강점 | 적합한 상황 |

|---|---|---|---|

| LangGraph | LangChain | 상태 기반 그래프로 세밀한 흐름 제어 | 복잡한 워크플로우, 분기/합류가 많은 에이전트 |

| CrewAI | CrewAI | 멀티 에이전트 팀 협업 구조 | "기획자→개발자→QA" 같은 역할 분담 시나리오 |

| Agents SDK | OpenAI | 경량 구조, 빠른 프로토타이핑 | 싱글 에이전트, 빠른 PoC |

| Agent SDK | Anthropic | 안전성·제어 가능성 중심 설계 | Claude 모델 기반, 프로덕션 안전성 중시 |

초보자라면 OpenAI Agents SDK나 Claude Agent SDK로 감을 잡고, 프로젝트가 복잡해지면 LangGraph로 넘어가는 경로가 현실적이다. CrewAI는 "에이전트가 여러 명이어야 하는" 명확한 이유가 있을 때 고려하면 된다. 멀티 에이전트가 무조건 좋은 건 아니니까.

솔직히 아직 불안한 부분들

Agentic AI가 만능처럼 들릴 수 있는데, 현실은 좀 다르다.

가장 큰 문제는 오류 누적이다. 에이전트가 10단계 계획을 세웠는데 3단계에서 판단을 잘못하면, 나머지 7단계가 전부 엉뚱한 방향으로 달린다. 챗봇은 한 번 틀려도 다음 질문에서 바로잡을 수 있는데, 에이전트는 자율적으로 움직이니까 문제를 발견했을 때는 이미 꽤 진행된 후일 수 있다. 그래서 중간중간 사람의 승인을 받는 "human-in-the-loop" 패턴이 중요해졌다.

비용도 무시 못 한다. 에이전트는 하나의 작업을 처리하면서 LLM을 수십 번 호출한다. 도구 결과를 해석하고 → 다음 행동을 결정하고 → 또 도구를 호출하고. 간단한 작업인데 에이전트를 투입하면 비용 대비 효과가 안 나올 수 있다. "이걸 에이전트로 풀어야 하나, 그냥 스크립트로 짜면 되는 거 아닌가?"라는 판단이 항상 필요하다.

보안 이슈도 빠질 수 없다. 에이전트가 코드를 실행하고, 파일을 수정하고, 외부 API를 호출할 수 있다면 공격 표면(attack surface)이 넓어진다. 악의적인 프롬프트 인젝션으로 에이전트의 행동을 조작할 가능성도 있고. 그래서 요즘 프레임워크들은 권한 제어, 샌드박싱, 도구 호출 승인 같은 안전장치에 꽤 신경을 쓰고 있다.

그래서, 어디로 가고 있나

"AI한테 물어보는" 시대에서 "AI한테 시키는" 시대. 그게 Agentic AI가 가리키는 방향이다. 단순한 유행이 아니라 AI 활용의 패러다임 자체가 바뀌는 흐름이라고 보는 시각이 많다.

그렇다고 당장 모든 걸 에이전트에 맡기겠다는 건 과욕이다. 아직 감독이 필요하고, 비용 대비 효과를 따져야 하는 상황이 많다. 지금 시점에서 중요한 건 이 기술이 뭔지 이해하고, 자기 업무에서 어디에 적용하면 효과적일지 감을 잡는 거다.

어차피 에이전트가 더 똑똑해지는 건 시간문제니까. 준비는 빠를수록 좋다.